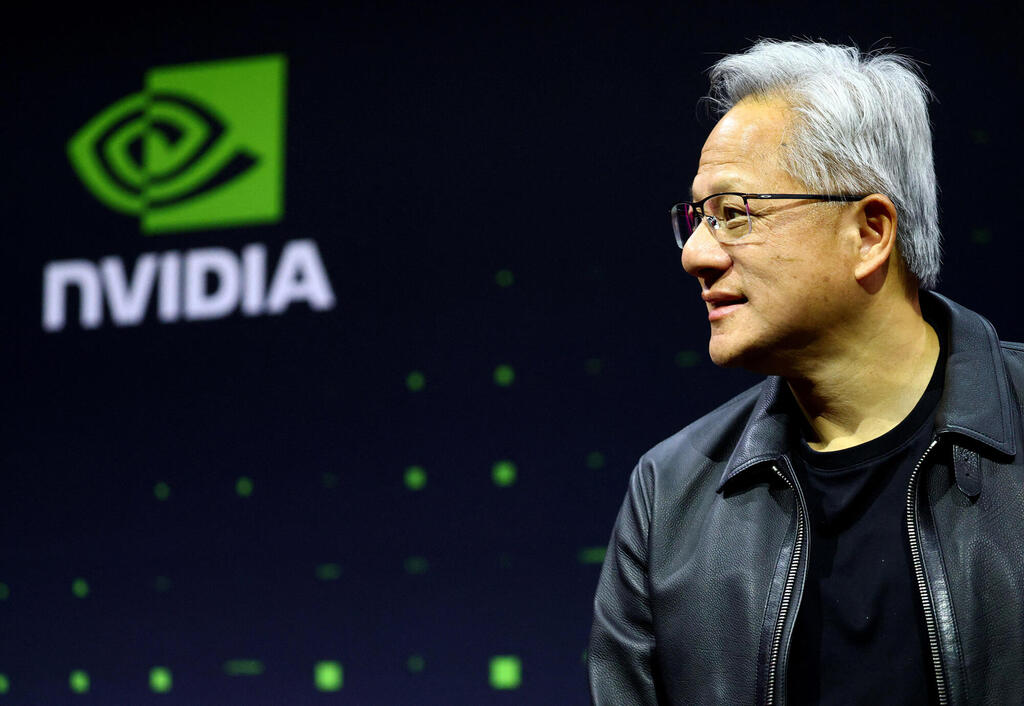

Der Konzern Nvidia hat die neue Plattform für künstliche Intelligenz Rubin vorgestellt, bei deren Entwicklung Forschung und Ingenieurteams in Israel eine zentrale Rolle gespielt haben. Die Lösung ist für das Training und den Betrieb von KI-Modellen ausgelegt und soll laut Unternehmen den Rechenaufwand sowohl beim Training als auch bei der Inferenz deutlich reduzieren. Die Plattform kombiniert sechs spezialisierte Chips, die gemeinsam als eng gekoppelter KI-Supercomputer arbeiten. Bei Nvidia betonen sie, dass die Architektur von Rubin vor dem Hintergrund eines stark wachsenden Bedarfs an Rechenleistung konzipiert wurde. Die Entwicklung ist Teil des jährlichen Aktualisierungszyklus der KI-Infrastruktur des Unternehmens. Die Website Imowell.de berichtet unter Berufung auf Сalcalistech.

Architektur der Rubin-Plattform und die Rolle Israels

Im Zentrum der neuen Plattform steht der KI-Prozessor Rubin, ergänzt durch den Zentralprozessor Vera, eine Data Processing Unit sowie drei Kommunikationschips. Ein erheblicher Teil dieser Komponenten wurde im Forschungs- und Entwicklungszentrum von Nvidia in Israel oder unter maßgeblicher Beteiligung israelischer Ingenieurteams entwickelt. Zum System gehören die DPU BlueField-4, der Netzwerkadapter ConnectX-9 SuperNIC sowie die Switches NVLink 6 und Ethernet Spectrum-6. Alle genannten Netzwerkkomponenten stammen aus israelischer Entwicklung. Nvidia hebt hervor, dass die enge Verzahnung von Rechen- und Netzwerktechnologie entscheidend für die gesteigerte Effizienz war.

Leistung und Ressourceneinsparungen

Nach Angaben des Unternehmens bietet die Rubin-Plattform eine deutlich höhere Leistung als die vorherige Generation Blackwell. Das System kann Modelle vom Typ Mixture of Experts mit viermal weniger KI-Chips trainieren. Gleichzeitig sollen sich die Kosten für die Inferenz um bis zu 90 Prozent senken lassen. Nvidia erklärt, dass diese Werte die Plattform besonders für große Unternehmenskunden und Entwickler komplexer Modelle attraktiv machen. Der Fokus lag dabei nicht nur auf höherer Geschwindigkeit, sondern auch auf der Reduzierung des Energieverbrauchs und der Infrastrukturkosten.

Namensgebung der Plattform und Reaktionen

Die Plattform ist nach Vera Rubin benannt, einer jüdisch-amerikanischen Astronomin, deren Arbeiten zur Galaxiendynamik eine zentrale Rolle bei der Entdeckung der Dunklen Materie spielten. Nvidia verweist auf die symbolische Bedeutung des Namens, der einen Bezug zur Grundlagenforschung herstellt. Die Unternehmensführung sieht Rubin als Antwort auf den stark steigenden Bedarf an KI-Rechenleistung. Auch Partner des Konzerns betonen die Bedeutung effizienterer Infrastrukturen für die Skalierung moderner Modelle. Rubin wird als weiterer Entwicklungsschritt innerhalb des KI-Ökosystems von Nvidia eingeordnet.

Markteinführung und weitere Pläne

Nvidia teilte mit, dass Systeme auf Basis der Rubin-Plattform in der zweiten Hälfte des Jahres 2026 für Unternehmenskunden verfügbar sein sollen. Der Konzern baut seine Präsenz in Israel weiter aus und investiert verstärkt in lokale Forschungszentren. Nach Angaben von Nvidia bleiben israelische Ingenieurteams ein zentraler Bestandteil der globalen KI-Strategie des Unternehmens. Die Plattform Rubin gilt dabei als Schlüsselelement für kommende Supercomputer-Lösungen von Nvidia.

Sie könnten interessiert sein: Was das KI-Update von Fire TV für Nutzer in Deutschland bedeutet und warum Amazon seine Strategie ändert